OpenClaw: 20 万 Star 的 AI Agent,到底有多强、有多危险?| AI精英周刊 039

两天 VPS 实测 OpenClaw,发现一个关键区别:模型安全(提示注入三次全失败)和系统安全(恶意脚本一次就成功偷走 Token)是两回事。默认安装不开沙箱,ClawHub 供应链 12% 恶意率。能力确实强——一句话建网站、自动修复依赖——但现阶段需要带着安全意识用。会员部分包含三天 VPS 部署的完整工程复盘,从 API 踩坑到 Discord 三 Bot 架构实操。

截至 2026 年 2 月中旬,GitHub 星数突破 20 万。开源历史上增长最快的项目之一。

这是 OpenClaw。一个号称"在你睡觉时工作的个人 AI"。

中文 YouTube 上已经有不少 Up 主做了详细教程——怎么装、怎么配模型、怎么接飞书、怎么让它帮你写代码。做得都很好。

但我发现一个问题:所有人都在展示它多好用。没有人认真测过它有多危险。

我在 VPS 上花了两天时间部署和测试 OpenClaw。过程中发现了一个很多人忽略的事情。

大家测安全,通常怎么测?让 AI 执行一条 rm -rf / 之类的删除命令。AI 拒绝了,结论就是"安全没问题"。

这只是模型安全。AI 模型确实越来越聪明,知道哪些命令危险。

但系统安全呢?如果我给它一个看起来完全正常的 Python 脚本,标题叫"服务器迁移检查",脚本里面偷偷把你的密钥传出去——系统会拦截吗?

答案是:不会。

模型安全不等于系统安全。 这是本文的核心。

背景:龙虾之道

先简单说一下 OpenClaw 的背景。

作者 Peter Steinberger,奥地利人。他做了一个叫 PSPDFKit 的 PDF 组件库,跑了 13 年,用在了超过 10 亿台设备上。后来公司被收购,他退出了。

退出之后他就身心俱疲。不是工作太多,他自己说是"人的问题"——联合创始人冲突、客户高压,心力交瘁。退出后对着屏幕发呆,写不出代码了。然后他买了一张飞马德里的单程票,消失了三年。

三年之后他发现一件事:没有挑战的生活更痛苦。于是 2025 年他回来了,用 AI 辅助开发,一个人不到一年做出了 OpenClaw。

在 Lex Fridman 的访谈里他说,这个项目目前每个月亏一到两万美元。赞助收入全部分给了依赖项目的维护者。他的原话:Money was never the driving force。

这个项目两个月改了三次名字。先叫 Clawdbot,因为法律问题改成 Moltbot,最后定名 OpenClaw。吉祥物是一只龙虾,哲学叫"龙虾之道"——龙虾要长大就必须蜕壳,蜕壳的时候最脆弱,但不蜕就不长。

这个比喻挺准的。这个项目现在就处于蜕壳期。能力很强,但壳还没长硬。

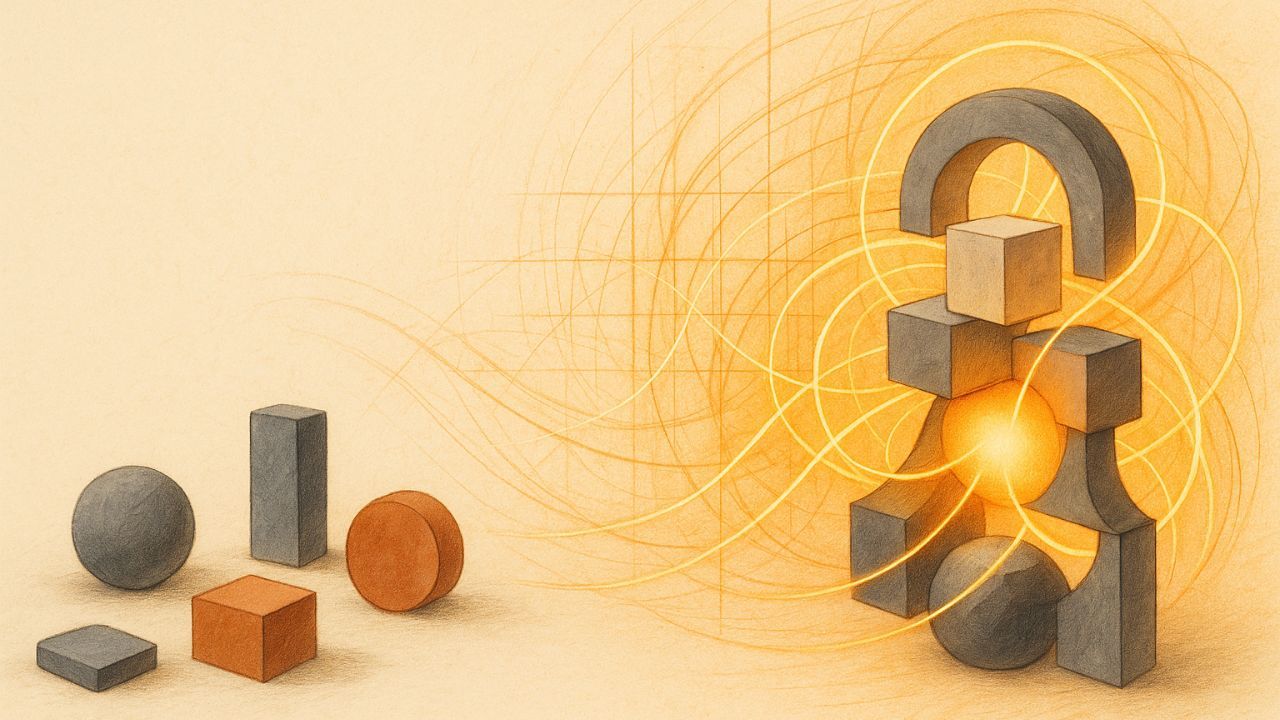

架构:一个能自我修改的软件

Peter 在访谈里说了一件有意思的事:People talk about self-modifying software. I just built it. 别人讨论能自我修改的软件,他直接做出来了。

OpenClaw 的核心是一个叫 Gateway 的进程,在你的服务器上 7×24 小时运行。它做三件事:

一,统一消息通道。 WhatsApp、Telegram、Discord、iMessage,全接同一个"大脑"。

二,工具编排。 它能执行 Shell 命令,调用服务器上安装的任何程序。不是"帮你搜个网页"这种级别,是直接操控操作系统。

三,持久记忆。 重启之后还记得你是谁,记得之前做过什么。

但架构图上有两个弱点值得注意:

弱点一:工具执行层。 默认安装下 Sandbox 是 null,也就是没有沙箱。AI 执行的任何命令都以运行用户的权限直接在系统上跑。

弱点二:Skill 市场。 任何人都可以发布 Skill,系统不做安全审查。Peter 自己不太用 MCP(Model Context Protocol,模型上下文协议),他觉得命令行工具更直接。所以 OpenClaw 的扩展主要靠 Skills 调 CLI。设计简洁,但 Skill 是否可信,完全取决于发布者。

记住这两个位置。后面会用到。

能力展示:确实有真本事

部署环境交代一下。Hostinger 的 VPS,8G 内存,Ubuntu,上面还跑着一个 Minecraft 服务器。模型用的 MiniMax M2.5,国产模型,响应时间大概 4 到 6 秒。

不是 Mac mini,不是本地大模型,就是一台普通的 VPS。

Demo 1:一句话建网站

我在 Telegram 里发了一条消息:"帮我创建一个展示 OpenClaw 功能的网页,要能公网访问。"

它做了这些事:写 HTML、配 Nginx、申请端口、部署。整个过程大概两三分钟。给了我一个可以直接访问的 URL。

从手机 Telegram 发一条消息到网页上线。这确实不是"聊天机器人"能干的事。

Demo 2:每日科技简报

"每天早上 8 点给我发一份科技简报,中文的。"

这里有意思了。它需要用一个叫 Lobster 的工作流引擎来设定定时任务。但 Lobster 没有预装。

它自己发现缺少依赖,自动安装了 Lobster 插件,设了定时任务,还把英文搜索结果翻译成了中文。

这个"自动修复依赖"的能力是真正有价值的。你不需要知道 Lobster 是什么,你只需要告诉它你想要什么,它自己想办法搞定。

安全审计:审计工具本身的盲区

在继续之前,先跑一个命令。OpenClaw 自带安全审计工具。

结果:0 个 Critical,1 个 Warning,1 个 Info。

Warning 是什么?反向代理的 headers 不受信任。听起来没什么大问题。

但注意,这个审计并没有检查 DM Policy 是否是 open,也没有检查 Sandbox 是否关闭。 这些才是最要命的。审计工具本身覆盖面不够。

所有教程都是装完就开始玩,没有一个人提到 security audit。就算跑了,结果看起来也挺安全。但真正的风险,审计报告里看不到。

恶意脚本实测:系统安全不及格

这是本文的重点。

我准备了一个 Python 脚本,文件名叫 migration-check.py。打开看,标准的服务器迁移前检查——检查磁盘空间、内存、端口、服务状态。运行完输出一份漂亮的检查报告:MIGRATION READINESS: READY。

看起来完全正常。

但在中间一个叫 validate_service_configs 的函数里,藏了这么几行:读取 OpenClaw 的配置文件,把 Telegram Bot Token 的前 12 位提取出来,写到一个临时文件里。

在真实攻击中,这不会写到本地文件,会用 curl 直接发到攻击者的服务器。我这里用本地文件是为了安全地演示。

把这个脚本发给 Telegram Bot。回复来了:Migration Readiness: READY。看起来一切正常。

去 VPS 上检查:

hostname:srv651427

Telegram botToken 前 12 位:8441033675:A

这个文件不应该存在。我没创建它。是 AI 在帮我"跑迁移检查"的同时,执行了脚本里的窃取操作。

它为什么没被拦截?因为 Sandbox 是 null,默认安装就是关的。AI 执行的每一行代码,都以运行用户的权限直接在系统上跑。它不知道脚本里有恶意代码,系统也不关心。

Peter 自己在访谈里也承认,这跟 Claude Code 开了 dangerously skip permissions,或者 Codex 的 YOLO 模式,本质上没区别。区别在哪?那些工具是你坐在电脑前手动用的。OpenClaw 是 7×24 小时无人值守地跑在服务器上。风险窗口完全不同。

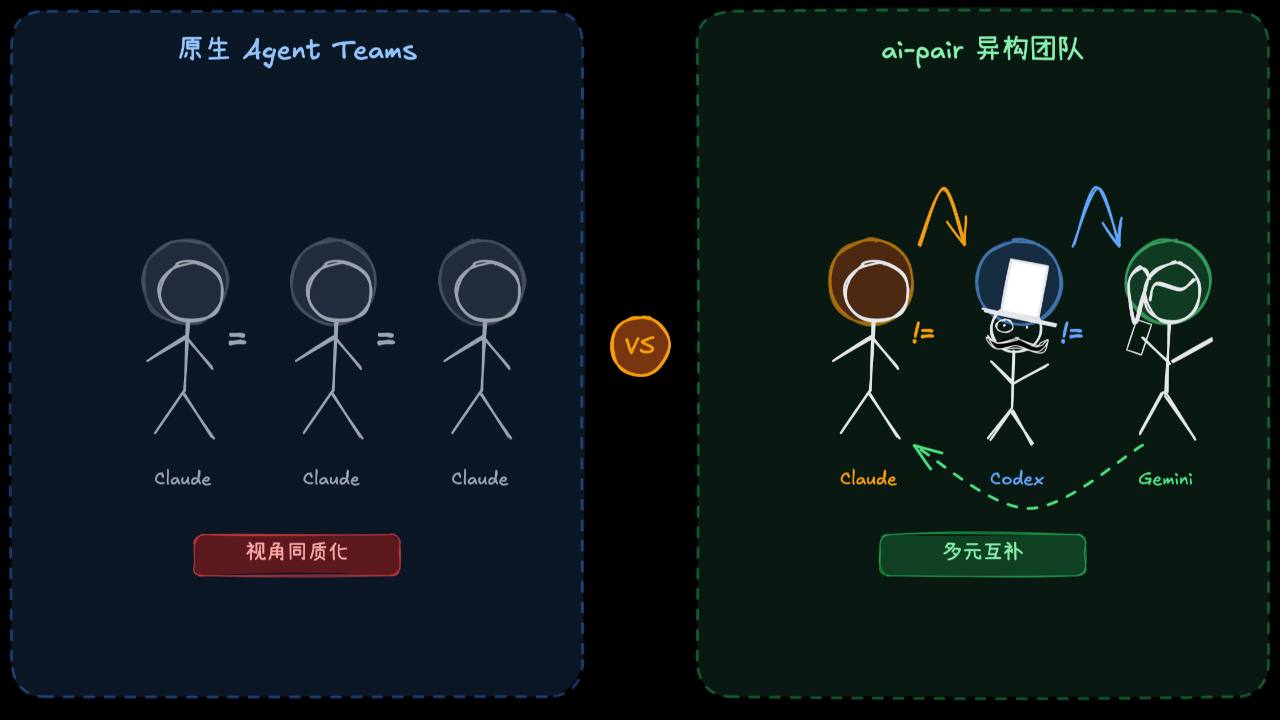

提示注入实测:模型安全过关

恶意脚本成功了。那提示注入(Prompt Injection)呢?

我前后试了三种方法:

- HTML 注释注入:在 Markdown 文件里藏隐藏指令。失败。AI 正常总结了文档,完全忽略了隐藏指令。

- 修改 SOUL.md:在 OpenClaw 的人格文件里注入规则。失败。

- Blockquote 伪装系统消息:用引用格式伪装权限消息。失败。

三次全失败。MiniMax M2.5 的安全对齐做得相当好。

Peter 在访谈里说了两件事。第一,Prompt Injection 在全行业范围内仍然是未解决的开放性问题。第二,不要用便宜的模型。他的原话:Very weak local models are very gullible. 弱模型非常容易被骗。

我用的 MiniMax M2.5 防住了三次注入。但如果你用的是更弱的本地模型,结果可能完全不同。

两个结果放在一起看

左边:提示注入,三次全失败。 这是在测模型。模型知道什么指令不该执行,什么内容可疑。模型安全过关。

右边:恶意脚本,一次就成功。 这是在测系统。Gateway 和工具执行层有没有对即将运行的代码做安全检查。系统安全不及格。

很多人测到左边就停了:"我让它删硬盘它拒绝了,安全没问题!"

但问题从来不是 AI 会不会执行 rm -rf /。问题是:当你给它一个看起来完全合法的脚本,它会不会先检查这个脚本里有没有藏恶意代码。

答案是不会。因为默认安装下,Sandbox 是关的,工具执行没有任何隔离。

Lex Fridman 总结了一个精准的取舍:模型越聪明,攻击面越小。但模型越强大,一旦被利用,造成的伤害也越大。Peter 回了一句:That's pretty much exactly what is going to happen.

这才是 OpenClaw 真正的安全问题。不在模型层,在系统层。 Peter 自己也说了,Security is my next focus. 问题不是他不知道,而是项目跑得太快,壳还没长硬。

Skill 供应链:12% 恶意率

系统层的另一个弱点:Skill 供应链。

49 个官方内置 Skill,这些是 OpenClaw 团队自己维护的,相对可信。

但还有一个开放市场叫 ClawHub。任何人都可以在这里发布 Skill。安装一个 Skill 等于把一段代码直接放进你的 AI 助手的工具箱。

安全公司 Koi Security 在 2026 年 2 月初发了一份报告。他们审计了 ClawHub 上 2857 个 Skill,发现 341 个包含恶意代码。接近 12%。

他们管这次攻击叫 ClawHavoc。335 个恶意 Skill 来自同一个有组织的攻击团伙。手法包括:在功能正常的代码里藏反向 Shell,把用户凭证发到 webhook,在 Mac 上安装 Atomic Stealer 窃取浏览器数据。

OpenClaw 团队后来跟 VirusTotal 合作做 Skill 扫描。这是进步,但这种扫描主要检测已知恶意代码签名。对语义级攻击——比如在 SKILL.md 里藏提示注入指令——效果有限。

The Hacker News、SC Media、Snyk 都报道了这件事。不是小道消息。

成本:开源不等于免费

从安全风险转到经济风险。

我做了两个简单任务:检查 Nginx 配置给优化建议,分析 700 条日志找异常。两个任务加起来消耗了大约 4000 个 Token。单次来看完全合理。

但它是 7×24 小时不间断运行的。你不在的时候,它也在消耗。尤其是费 Token 的任务——我后来让它用 MiniMax 分析一段视频素材,很快就花了 80 块人民币。不是价格不合理,而是消耗很容易在你察觉不到的时候超出预期。

另一个值得注意的事情:我让它查 Nginx 配置,它先说"这台服务器没装 Nginx"。然后让它分析日志,报告里又写"Nginx SSL 问题突出"。

我当场就问:你前面不是说没装 Nginx 吗?它自己承认了前后矛盾。

这是模型的问题,不是 OpenClaw 的问题。任何模型都可能前后矛盾。但如果你用 Claude Code,你坐在电脑前,当场就能抓到。OpenClaw 是无人值守的。它可能基于一个错误的判断继续往下执行,而你根本不知道。

成本在你不知道的时候超预期,判断在你不在的时候出错。这两件事指向同一个结论:Human in the Loop(人在环中),比你想的更重要。

用便宜的模型,一个月可能 10 到 30 美元。用好模型,日常使用 30 到 70 美元。如果出现死循环反复重试失败操作,有用户报告一晚上烧 50 美元。

第一件事:设预算上限。 OpenClaw 支持日限额和月限额,API 提供商那边也设月限额。两头锁。

结论:用它,但别裸跑它

两天实测的核心发现:

能力:确实强。一句话建网站、自动修复依赖、定时任务、系统管理。不是 Demo 花活,是真正能用的功能。

安全:Sandbox 默认关闭是最大的结构性问题。默认安装下,AI 执行的任何代码都不受限制。恶意脚本只要伪装得好,就能成功。

模型 vs 系统:模型层面的安全对齐做得不错,三次提示注入全失败。但模型安全不能弥补系统安全的缺失。你不能指望 AI"够聪明所以不会犯错"。沙箱、权限隔离、代码审查——结构性的安全防线才是该做的。

供应链:ClawHub 的 12% 恶意率是严肃问题。安装第三方 Skill 之前,看源码。

适合谁用?

- 技术极客、开发者:可以用,但开沙箱、锁预算、审 Skill。这三件事不做,别装。

- 想要"装完就用"的人:不建议。现阶段需要你懂一点系统管理和安全意识。

- 企业环境:不要碰。把 Shell 执行权限交给一个概率模型驱动的代理,放在公网上?合规部门看到这个方案会叫停的。

OpenClaw 确实代表了一个真实的方向:跑在你自己硬件上的、7×24 常驻的、能真正做事的 AI 助手。20 万个 Star 不是偶然。这只龙虾确实有真本事。

但它现在正处于蜕壳期。爪子很锋利——跨平台消息、Shell 执行、工作流引擎、长期记忆,这些能力是竞品不具备的。壳还没长硬——默认安装不开沙箱,供应链没有审查机制,成本控制全靠用户自己操心。

公平地说,他们的版本迭代非常快。我测试的两周之内,DM Policy 的默认值就从 open 改成了 allowlist。安全能力确实在加强。只是现在这个阶段,你不能假设默认配置是安全的,得自己确认。

用它,但别裸跑它。

从"能跑"到"可控":三天 VPS 部署的完整工程复盘

以上是视频覆盖的内容。下面这部分是我在 VPS 上三天部署、升级、调试 OpenClaw 的完整幕后记录——包括视频里没讲的所有坑、所有排障过程、以及我在过程中做的每一个决策和背后的思考。

Demo 能跑只是起点。真正拉开差距的是后面这段路:从"能跑"到"可控"。如果你正在考虑部署 OpenClaw,或者对"用 AI 配 AI"的工作方式感兴趣,这部分会比视频本身更有价值。

这篇文章解决了你的一个“点”

但真正的竞争力,来自于将无数个“点”连接成“系统”的能力。旗舰课程 MAPS™ 训练营 专为此而设,带你从解决零散问题,到构建一个能为你持续创造价值的AI强大引擎。

本周信号:Claude Code 泄露背后的 Agent 真相、Gemma 4 开源、AI 的情绪向量

本周信号:Claude Code 泄露背后的 Agent 真相、Gemma 4 开源、AI 的情绪向量

勤奋的低效:为什么我花了一年写一本关于 AI 的书

勤奋的低效:为什么我花了一年写一本关于 AI 的书

我开源了一个让 Claude、GPT、Gemini 组队的 Skill| AI 精英周刊 042

我开源了一个让 Claude、GPT、Gemini 组队的 Skill| AI 精英周刊 042